Erfahrungsbasierte Steuerung skaliert nicht in turbulenten Systemen

Die Disposition gehört zu den zentralen Steuerungsfunktionen jeder Supply Chain. Über Jahrzehnte hinweg funktionierte sie in vielen Unternehmen erstaunlich zuverlässig: Erfahrene Disponenten kombinierten ERP‑Vorschläge mit Marktkenntnis, historischen Daten und persönlichem Urteil. In relativ stabilen Märkten führte dieses Zusammenspiel aus Systemlogik und Erfahrung meist zu pragmatischen und funktionierenden Entscheidungen.

Doch die Rahmenbedingungen haben sich grundlegend verändert. Lieferketten sind volatiler geworden, Variantenvielfalt und SKU‑Zahlen steigen, und externe Störungen – von geopolitischen Konflikten bis zu Lieferantenausfällen – treten häufiger und weniger vorhersehbar auf. Viele Planungsprozesse arbeiten jedoch weiterhin mit Instrumenten und Methoden, die für eine deutlich stabilere Umwelt entwickelt wurden.

Die Folge: Dispositionsentscheidungen basieren häufig auf fragmentierten Daten, historisch gewachsenen Sicherheitsbeständen, kaum gepflegten Systemparametern und menschlichen Entscheidungsheuristiken. Was in stabilen Systemen funktioniert hat, stößt unter turbulenten Bedingungen zunehmend an seine Grenzen. Erfahrungsbasierte Steuerung skaliert in solchen Umgebungen nicht mehr.

Von stabilen Lieferketten zu turbulenten Systemen

Die klassische Disposition entstand in einer Zeit vergleichsweise stabiler Rahmenbedingungen. In diesem Umfeld konnte Erfahrungswissen viele Schwächen von Daten und Systemen kompensieren.

Mit wachsender Komplexität verändert sich jedoch die Natur der Aufgabe grundlegend. Entscheidend ist heute weniger die Erfahrung einzelner Disponenten als die Fähigkeit, komplexe Zusammenhänge konsistent abzubilden.

Vier strukturelle Muster zeigen, warum viele Dispositionsprozesse mit dieser Entwicklung zunehmend Schwierigkeiten haben.

1. Excel‑Parallelwelten: Wenn die Datenbasis fragmentiert ist

In vielen Unternehmen ist Excel noch immer das wichtigste operative Planungsinstrument der Disposition. Selbst dort, wo leistungsfähige ERP‑Systeme im Einsatz sind, werden Bedarfsentwicklungen, Bestandsübersichten oder Szenarioanalysen häufig in Tabellenkalkulationen ausgelagert. Produktion, Einkauf, Vertrieb und Disposition arbeiten mit eigenen Dateien, die regelmäßig per E‑Mail oder über gemeinsame Laufwerke ausgetauscht werden. So entstehen parallele Datenwelten.

Diese Arbeitsweise hat mehrere strukturelle Schwächen. Erstens fehlt eine gemeinsame, konsistente Datenbasis. Sobald eine Tabelle versendet wird, ist sie im Grunde bereits veraltet. Änderungen in einer Abteilung werden von anderen Bereichen häufig erst zeitverzögert sichtbar. Entscheidungen beruhen damit oft auf unterschiedlichen Informationsständen.

Zweitens sind Tabellenkalkulationen fehleranfällig. Formeln werden angepasst, Werte manuell überschrieben oder Daten unvollständig übertragen. In komplexen Planungstabellen genügt bereits ein kleiner Fehler, um Bestandsentwicklungen oder Bedarfsprognosen zu verfälschen. In der Disposition können solche Fehler unmittelbare operative Folgen haben – etwa falsche Bestellmengen, verspätete Beschaffungsentscheidungen oder unnötige Bestandsaufbauten.

Drittens erschweren Excel‑basierte Planungsprozesse die Zusammenarbeit. Wenn mehrere Beteiligte parallel mit unterschiedlichen Versionen einer Datei arbeiten, entstehen leicht Inkonsistenzen und Abstimmungsaufwand. Ein erheblicher Teil der Arbeitszeit von Disponenten fließt dann nicht in die Bewertung von Planungsentscheidungen, sondern in das Sammeln, Prüfen und Konsolidieren von Daten.

In relativ stabilen Umgebungen ließ sich dieses Vorgehen lange Zeit pragmatisch beherrschen. Mit zunehmender Dynamik der Lieferketten wird die Fragmentierung der Datenbasis jedoch zunehmend zum Problem. Je schneller sich Nachfrage, Lieferzeiten oder Bestände verändern, desto stärker wirken sich verzögerte oder inkonsistente Informationen auf die Qualität der Dispositionsentscheidungen aus.

Damit wird ein grundlegendes Spannungsfeld sichtbar: Während moderne Supply Chains immer stärker vernetzt und dynamisch werden, basieren viele Planungsprozesse weiterhin auf Werkzeugen, die ursprünglich für individuelle Analysen und nicht für die integrierte Steuerung komplexer Systeme entwickelt wurden.

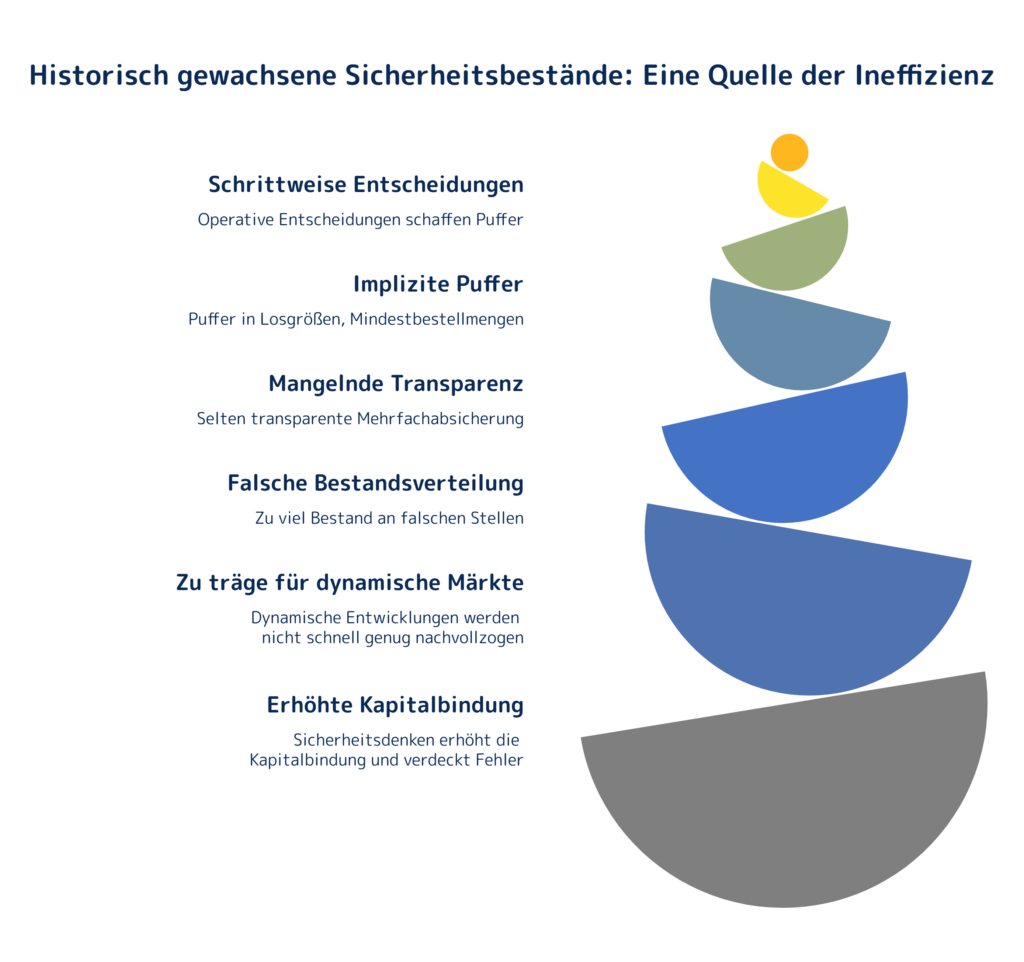

2. Historisch gewachsene Sicherheitsbestände

Ein zweites strukturelles Muster vieler Dispositionssysteme sind Sicherheitsbestände, die nicht systematisch geplant, sondern über Jahre hinweg gewachsen sind. In der Praxis entstehen sie häufig schrittweise durch operative Entscheidungen: Der Vertrieb erhöht Mindestbestände für wichtige Artikel, die Disposition reagiert auf Lieferunsicherheiten mit zusätzlichen Puffern, und der Einkauf verlängert vorsorglich Wiederbeschaffungszeiten oder Losgrößen.

Jede dieser Maßnahmen erscheint für sich genommen plausibel. In der Summe entstehen jedoch mehrere, oft unsichtbare Sicherheitsschichten entlang der gesamten Lieferkette. Sicherheitsbestände werden im ERP-System hinterlegt, zusätzlich entstehen implizite Puffer in Losgrößen, Mindestbestellmengen oder vorgezogenen Bestellterminen. Das Ergebnis ist eine Mehrfachabsicherung, die selten transparent ist.

Viele Unternehmen stellen erst bei einer systematischen Analyse fest, dass ein erheblicher Teil ihrer Bestände historisch entstanden ist und nie aktiv geplant wurde. Häufig liegt von den falschen Artikeln zu viel Bestand an den falschen Stellen der Lieferkette.

In stabilen Märkten konnten solche Sicherheitsreserven lange Zeit als pragmatische Versicherung gegen Unsicherheit funktionieren. In dynamischeren Supply Chains führen sie jedoch zunehmend zu neuen Problemen. Hohe Bestände binden Kapital, verdecken Planungsfehler und verzögern die Reaktion auf Veränderungen in der Nachfrage.

Damit entsteht ein paradoxer Effekt: Sicherheitsbestände sollen Unsicherheit abfedern – können aber in komplexen Systemen selbst zu einer Quelle zusätzlicher Ineffizienz werden.

3. Dispositionsregeln, die niemand mehr pflegt

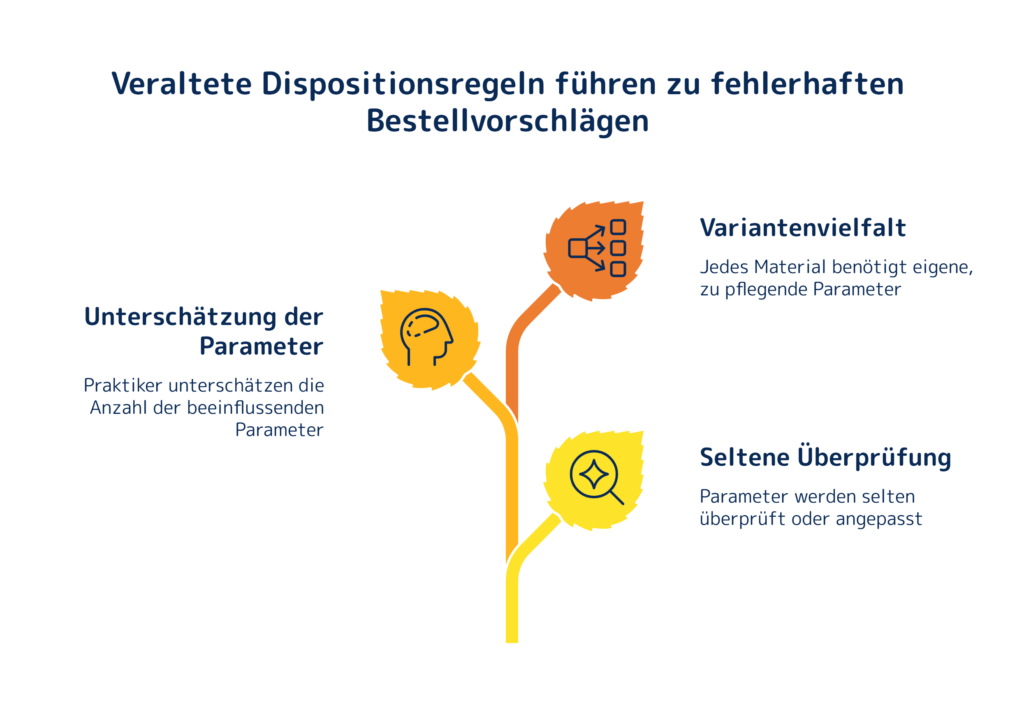

Ein drittes Problem liegt weniger in den Werkzeugen als in der Pflege der zugrunde liegenden Dispositionsregeln. Moderne ERP‑Systeme arbeiten mit einer Vielzahl von Parametern – etwa Wiederbeschaffungszeiten, Losgrößen, Prognoseverfahren oder Sicherheitsbeständen. Diese Parameter bestimmen maßgeblich, welche Bestellvorschläge das System erzeugt.

In der Praxis werden viele dieser Einstellungen jedoch nur selten überprüft oder angepasst. Häufig stammen sie noch aus der Einführungsphase des ERP-Systems oder aus früheren Marktbedingungen und bleiben anschließend über Jahre unverändert. Gleichzeitig verändern sich jedoch Nachfrageverhalten, Lieferzeiten oder Produktprogramme kontinuierlich. Zwischen den Annahmen im System und der Realität entsteht dadurch schrittweise eine wachsende Lücke.

Hinzu kommt ein zweiter, weniger offensichtlicher Punkt: Viele Praktiker unterschätzen die tatsächliche Zahl der Parameter, die die Dispositionslogik eines ERP-Systems beeinflussen. In vielen Dispositionsabteilungen besteht die Vorstellung, dass im Wesentlichen nur einige wenige Stellgrößen – etwa Sicherheitsbestand, Wiederbeschaffungszeit, Losgröße oder Prognoseverfahren – regelmäßig gepflegt werden müssen.

Tatsächlich verfügen moderne ERP-Systeme jedoch über eine deutlich größere Zahl möglicher Steuerungsparameter. Je nach System können mehrere Dutzend, teilweise sogar weit über hundert Einstellungen die Dispositionslogik beeinflussen – von Prognosemethoden über Servicelevel-Parameter bis hin zu Rundungsregeln, Planungszeitfenstern oder Dispositionsstrategien. Viele dieser Parameter sind bei der Einführung des Systems einmal auf Standard- oder Defaultwerte gesetzt worden und bleiben anschließend unverändert, obwohl sie nicht unbedingt zur jeweiligen Materialstruktur oder zum Nachfrageverhalten passen.

Das Spektrum der Parameter, die für eine saubere Dispositionslogik eigentlich überprüft werden müssten, ist damit deutlich größer als viele Anwender in der Praxis vermuten.

Mit wachsender Variantenvielfalt verschärft sich dieses Problem zusätzlich. Jedes Material besitzt eigene Dispositionsparameter, die grundsätzlich regelmäßig überprüft werden müssten. Steigt die Zahl der Artikel, wächst auch die Zahl der Parameter, die gepflegt werden müssten – oft ohne dass dafür zusätzliche Ressourcen zur Verfügung stehen.

Das Ergebnis ist ein schleichender Drift zwischen Systemlogik und Realität. Dispositionssysteme arbeiten mit Annahmen über Bedarfsverläufe, Lieferzeiten oder Losgrößen, die längst nicht mehr gelten. Bestellvorschläge sind dann zwar formal korrekt berechnet, beruhen jedoch auf veralteten Prämissen.

Damit zeigt sich ein grundlegendes Skalierungsproblem: Nicht der Algorithmus ist das zentrale Problem, sondern die manuelle Beherrschung seiner Parameter. Je komplexer Produktprogramme und Lieferketten werden, desto schwieriger wird es, diese Regeln konsistent und aktuell zu halten.

4. Bauchgefühl als Steuerungsgröße

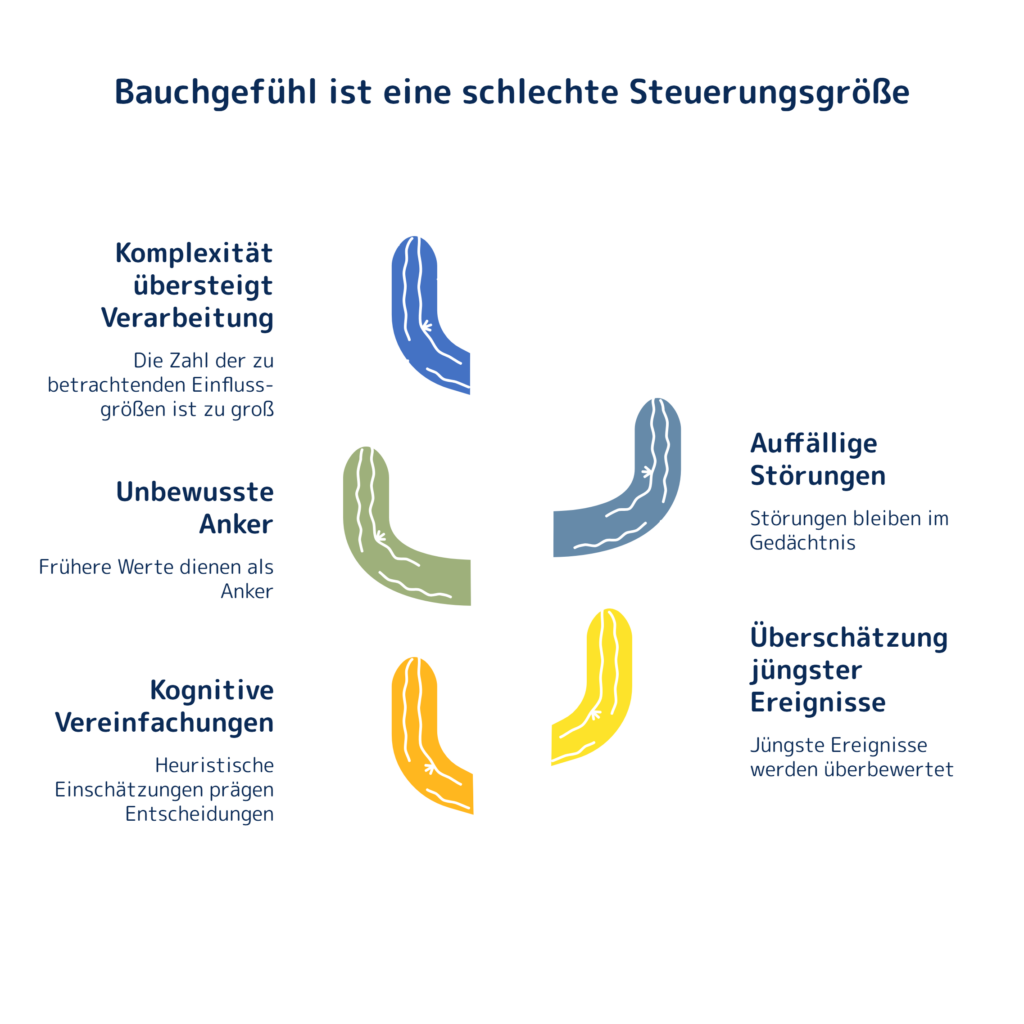

Neben Datenfragmentierung, historisch gewachsenen Beständen und ungepflegten Dispositionsregeln spielt in vielen Unternehmen noch ein weiterer Faktor eine große Rolle: das menschliche Urteil. Disponenten greifen regelmäßig in Systemvorschläge ein, passen Prognosen an oder verändern Bestellmengen auf Basis ihrer Erfahrung.

Grundsätzlich ist dieser Eingriff nachvollziehbar. In vielen Situationen verfügen Praktiker über Kontextwissen, das im System nicht abgebildet ist – etwa Informationen über bevorstehende Marktaktionen, Lieferantenprobleme oder kurzfristige Nachfrageschwankungen. Erfahrung kann daher ein wertvoller Bestandteil der Planung sein.

Problematisch wird es jedoch, wenn menschliche Eingriffe systematisch an die Stelle analytischer Planung treten. Entscheidungen werden dann häufig von heuristischen Einschätzungen geprägt: jüngste Ereignisse werden überbewertet, frühere Werte dienen als unbewusste Anker, und besonders auffällige Störungen bleiben stärker im Gedächtnis als statistisch typische Entwicklungen.

Solche kognitiven Vereinfachungen sind in überschaubaren Systemen oft unproblematisch. Mit wachsender Komplexität stoßen sie jedoch an Grenzen. Wenn tausende Artikel, volatile Nachfrage und internationale Lieferketten gleichzeitig berücksichtigt werden müssen, übersteigt die Zahl relevanter Einflussgrößen schnell das, was erfahrungsbasierte Einschätzungen zuverlässig verarbeiten können.

Erfahrung bleibt damit wichtig – sie verliert jedoch ihre Fähigkeit, ein komplexes System allein zu steuern. In turbulenten Supply Chains kann Bauchgefühl analytische Planung nicht ersetzen, sondern allenfalls ergänzen.

Wenn sich die Schwächen gegenseitig verstärken

Die beschriebenen Probleme treten in der Praxis selten isoliert auf. Vielmehr wirken sie häufig gleichzeitig – und verstärken sich gegenseitig.

Fragmentierte Daten erschweren eine konsistente Planung. Um diese Unsicherheit auszugleichen, greifen Disponenten häufiger manuell ein oder erhöhen vorsorglich Bestände. Historisch gewachsene Sicherheitsbestände wiederum verdecken Planungsfehler und verzögern die Rückmeldung aus dem System. Gleichzeitig arbeiten Dispositionsalgorithmen mit Parametern, die nicht mehr zur aktuellen Marktsituation passen.

Auf diese Weise entsteht ein selbstverstärkender Mechanismus: Unsichere Daten führen zu vorsichtigen Entscheidungen, zusätzliche Sicherheitsbestände verdecken die eigentlichen Ursachen von Planungsabweichungen, und manuelle Eingriffe übersteuern systematische Analysen. Jede einzelne Maßnahme erscheint im operativen Alltag plausibel – in der Summe erhöht sie jedoch die Komplexität des Systems.

Das Ergebnis ist eine Disposition, die immer stärker reaktiv arbeitet. Statt Schwankungen in der Nachfrage zu dämpfen, werden sie entlang der Lieferkette häufig verstärkt. Kleine Veränderungen im Bedarf können dadurch überproportionale Reaktionen in Bestellungen, Produktionsmengen oder Beständen auslösen.

Die vier beschriebenen Muster – fragmentierte Daten, historisch gewachsene Sicherheitsbestände, ungepflegte Dispositionsregeln und heuristische Eingriffe – sind daher nicht nur einzelne Schwachstellen. Gemeinsam bilden sie ein System, das unter zunehmender Komplexität immer schwieriger zu steuern ist.

Fazit: Ein System aus einer anderen Zeit

Die vier beschriebenen Muster zeigen ein gemeinsames Grundproblem: Viele Dispositionsprozesse basieren noch auf einem Planungsverständnis, das für eine deutlich stabilere Umwelt entwickelt wurde. In überschaubaren Systemen konnten erfahrene Disponenten Datenlücken, ungenaue Parameter oder unvollständige Modelle lange Zeit durch ihr praktisches Wissen kompensieren.

Mit wachsender Komplexität stößt dieses Modell jedoch an Grenzen. Steigende Variantenvielfalt, dynamische Märkte und global vernetzte Lieferketten erhöhen die Zahl der Einflussgrößen so stark, dass erfahrungsbasierte Steuerung allein nicht mehr ausreicht. Das Problem liegt dabei weniger bei den handelnden Personen als in der Struktur der Systeme, mit denen sie arbeiten.

Die entscheidende Frage für Unternehmen lautet daher nicht, ob ihre Disponenten engagiert oder erfahren genug sind. Entscheidend ist vielmehr, ob die eingesetzten Planungsmechanismen noch zur heutigen Komplexität der Supply Chains passen.

Welche Ansätze helfen können, Disposition in solchen Umgebungen wieder besser skalierbar zu machen, soll in einem nachfolgenden Artikel betrachtet werden.

FAQ – Häufig gestellte Fragen

Ist manuelle Disposition grundsätzlich falsch?

Nein. Manuelle Disposition ist nicht falsch, sondern war lange Zeit sehr effektiv.

Das Problem ist, dass sie für weniger komplexe und stabilere Systeme entwickelt wurde und unter heutigen Bedingungen nicht mehr ausreichend skaliert.

Warum ist Excel in der Disposition ein Problem?

Excel ist kein Problem als Werkzeug an sich, sondern in seiner Nutzung:

- erzeugt parallele Datenwelten

- verhindert Echtzeit-Transparenz

- ist fehleranfällig

- erschwert abteilungsübergreifende Zusammenarbeit

In komplexen Systemen führt das zu systematischen Inkonsistenzen.

Warum entstehen so viele Überbestände?

Überbestände entstehen selten durch eine einzelne Fehlentscheidung, sondern durch:

- additive Sicherheitslogiken in verschiedenen Abteilungen

- implizite Puffer (Losgrößen, Termine, Mindestmengen)

- fehlende Transparenz über die Gesamtsituation

Das System „überversichert“ sich selbst.

Liegt das Problem an den ERP-Systemen?

Nein. ERP-Systeme sind grundsätzlich leistungsfähig.

Das Problem liegt darin, dass:

- Parameter nicht regelmäßig gepflegt werden

- viele Parameter falsch oder unpassend eingestellt sind

- die Komplexität der Parametrisierung unterschätzt wird

→ Das System rechnet korrekt – aber auf falscher Basis.

Warum greifen Disponenten so häufig manuell ein?

Weil sie:

- Kontextwissen haben, das im System fehlt

- Systemergebnisse als unplausibel empfinden

- Verantwortung für Lieferfähigkeit tragen

Das Problem ist nicht der Eingriff an sich, sondern:

die systematische Übersteuerung analytischer Ergebnisse durch heuristische Einschätzungen

Wird Disposition durch Automatisierung überflüssig?

Nein. Die Rolle verändert sich.

Zukünftig geht es weniger um:

- manuelle Bestellentscheidungen

und mehr um:

- Überwachung von Systemen

- Interpretation von Ergebnissen

- Steuerung von Ausnahmen

Warum verstärken sich die Probleme gegenseitig?

Weil sie miteinander gekoppelt sind:

- schlechte Daten → mehr manuelle Eingriffe

- mehr Eingriffe → mehr Sicherheitsbestände

- mehr Bestände → weniger Transparenz

- schlechte Parameter → falsche Systemvorschläge

→ ein selbstverstärkender Regelkreis

Was ist die zentrale Erkenntnis des Artikels?

Die heutigen Herausforderungen der Disposition liegen nicht in einzelnen Schwächen, sondern im Zusammenspiel eines Systems, das für eine andere Komplexität entwickelt wurde.